Seit Dezember 2022 leitet Karola Marky die Forschungsgruppe „Digitale Souveränität“ am Lehrstuhl für Human-Centred Security (HCS) an der Ruhr-Universität Bochum. Für das Exzellenzcluster CASA forscht sie als PI im HUB D "Usability".

Sie promovierte am Telecooperation Lab an der TU Darmstadt, ihren Postdoc hat sie in der Forschungsabteilung Glasgow Interactive Systems (GIST) an der University of Glasgow in Schottland absolviert. Bevor sie nach Bochum kam, war sie Assistenzprofessorin im Empirischen Informationssicherheitslabor an der Leibniz Universität Hannover. Mit über 50 Publikationen in ihrem Forschungsfeld hat sie sich bereits jetzt ein internationales Renommee erarbeitet. Mehr zu Ihrem Werdegang erfahren Sie hier.

Die zahlreichen Auslandsaufenthalte haben viele positive Auswirkungen auf ihre heutige Arbeit, sagt Karola Marky. „Zum einen musste ich damals schon lernen, mit meinen Ressourcen sehr hauszuhalten. Das ist auch für die Wissenschaft wichtig. Zum anderen habe ich viele Industriekontakte sammeln können“, erzählt die Wissenschaftlerin, die inzwischen langjährige externe Kooperationspartnerin der Universität der Keio-Universität in Japan ist, und fügt hinzu: „Ich bin offen für gemeinsame Projekte und andere Kulturen, das hilft sehr beim Zusammenarbeiten. Und ich selbst war während dieser Reisen auch mal „die Ausländerin“ und habe mich viel mit Integration und kulturellen Unterschieden befasst. Ich finde, das sollte jeder mal selbst erlebt haben.“

Karola, was genau bedeutet „Digitale Souveränität“?

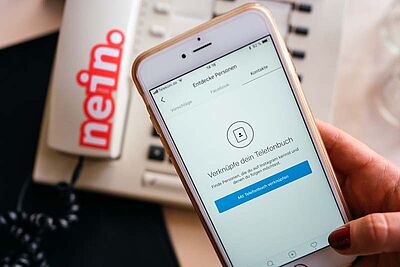

Bei der Digitalen Souveränität geht es um informationelle Selbstbestimmung im digitalen Raum. Es gibt dabei viele Unterschiede im Vergleich zur Selbstbestimmung im analogen Raum, in dem du viel Einfluss nehmen kannst. Wenn ich mit jemandem alleine sprechen möchte, mache ich in einem Raum die Türe zu und keiner hört mit. Im digitalen Raum muss diese Möglichkeit extra eingebaut sein. Man verliert schnell Überblick und Kontrolle darüber, was man im digitalen Raum eigentlich tut, welche Daten man weitergibt und was für Folgen das hat.

Wozu brauchen wir das?

Informationen, die wir preisgeben, können dafür sorgen, dass Einfluss auf unser Verhalten genommen werden kann. Wenn jemand während unseres Gesprächs im Raum ist, sage ich vielleicht etwas Anderes, als wenn ich alleine wäre. Dabei geht es nicht um Geheimniskrämerei. Wir brauchen Privatsphäre, weil sie uns schützt. Es gibt das sogenannte „Aufzug-Experiment“. Jemand kommt in einen Fahrstuhl, in dem alle anderen mit dem Rücken zur Türe und mit dem Gesicht zur Wand stehen. Intuitiv haben sich viele Personen genauso hingestellt, obwohl es keinen Sinn macht.

Wie werden wir im digitalen Raum beeinflusst?

Im digitalen Raum haben wir heute den sogenannten Surveillance Capitalism. Das bedeutet, dass wir mit Informationen, wenn wir sie gezielt auswerten, Aktionen von Menschen beeinflussen können, ohne, dass die Person es merkt. Nehmen wir das Beispiel Targeted Advertising, also wenn ich online shoppe und mir ähnliche Produkte angezeigt werden, die mir gefallen könnten. Das ist zwar ganz praktisch, kann aber dazu führen, dass ich etwas kaufe, was ich sonst nie gekauft hätte. Im Extremfall kann man durch diese Beeinflussung seine Freiheit verlieren. Wir Menschen sind aus psychologischer Sicht sehr anfällig für so etwas.

Wie steht das im Zusammenhang mit IT-Sicherheit?

Wir brauchen Mechanismen, die uns vor dieser Beeinflussung schützen. Das aktuelle Internet ist darauf nicht ausgelegt, sondern lässt die Beeinflussung vergleichsweise einfach zu. Es gibt die Forderung, das politisch zu lösen, aber damit würden wir eine Menge Funktionen verlieren. Ein Beispiel von schlechter Regulation sind Cookie-Banner: Rechtlich gesehen ist es in Ordnung, aber wenn User 50 Mal am Tag lesen und klicken müssen, ist das Verständnis über den Sinn nicht mehr vorhanden. Deshalb schauen wir uns auf psychologischer Basis das Nutzungsverhalten von Menschen an und entwickeln daraus die Mechanismen.

Wie erforscht ihr das Nutzungsverhalten?

Aktuell arbeite ich noch viel mit qualitativer Forschung. Künftig möchte ich mich darauf konzentrieren, Möglichkeiten zu entwickeln, die Menschen in ihrem Alltag begleiten, also beispielsweise eine App. Mit der sollen Menschen einfach zu ihrem Nutzungsverhalten befragt werden können, z.B. welche Sicherheitsmechanismen ihnen am Tag begegnet sind, wie sie damit umgegangen sind und so weiter. Außerdem möchte ich mich auf den Einsatz von virtueller Realität konzentrieren, mit der alltägliche Situationen der Nutzung von IT simuliert werden sollen. Momentan haben wir zudem noch einen 3D-Drucker, mit dem ich Interfaces verbessern will. Ich persönlich habe mir zum Beispiel eine kleine Katze für die 2-Faktor-Authentifizierung gedruckt. Wir nutzen Metaphern, mit denen wir IT-Sicherheit zugänglicher und personalisierter machen wollen.

Dieses „Outside the Box“-Denken zeichnet die junge Wissenschaftlerin aus, die nach ihrem Bachelor in Angewandter Informatik an der TU Kaiserslautern dem Uni-Leben für drei Jahre den Rücken gekehrt hat. In dieser Zeit hat sie nicht nur eine Solo-Weltreise mit dem Rucksack gemacht, sondern hat auch in Japan in einem Labor für Raumstationen gearbeitet.

Welchen Einfluss haben deine Auslandsaufenthalte auf deine heutige Forschung?

Zum einen musste ich damals schon lernen, mit meinen Ressourcen sehr hauszuhalten. Das ist auch für die Wissenschaft wichtig. Zum anderen habe ich viele Industriekontakte sammeln können“, erzählt die Wissenschaftlerin, die inzwischen langjährige externe Kooperationspartnerin der Universität der Keio-Universität in Japan ist, und fügt hinzu: „Ich bin offen für gemeinsame Projekte und andere Kulturen, das hilft sehr beim Zusammenarbeiten. Und ich selbst war während dieser Reisen auch mal „die Ausländerin“ und habe mich viel mit Integration und kulturellen Unterschieden befasst. Ich finde, das sollte jeder mal selbst erlebt haben.

Allgemeiner Hinweis: Mit einer möglichen Nennung von geschlechtszuweisenden Attributen implizieren wir alle, die sich diesem Geschlecht zugehörig fühlen, unabhängig vom biologischen Geschlecht.